A Whole New World

新しい世界を創る

Who We Are

次世代の安全で強力なAIを構築する。

私たちは、AIの最先端を切り拓く研究者、エンジニアからなるチームです。

モデル内部に隠された表現を理解し、評価し、守ります。

AIは錬金術ではない。AIは工学である。

AIを理解する・評価する・守る。

私たちの仕事は、3つの柱から成り立っています。基礎研究からプラットフォーム、運用防御までを一貫して提供することで、AI活用を推測(guesswork)ではなく工学(engineering)にします。

Understand

AIを理解する

モデル内部の意図表現・真実性・因果回路を可視化し、挙動の根拠を解明します。

LLM内部の意図表現を可視化する研究

モデル内に存在する「真実性」の方向を発見

推論回路のパスと影響度を解析する

Evaluate

AIを評価する

ホワイトボックス型評価基盤「AEGIS」と、攻撃シナリオを駆使したRed Teamで、モデルの潜在リスクを定量化します。

AEGIS — ホワイトボックス型モデル安全性評価基盤

潜在バイアスとサンドバギング(欺瞞)の検出

Jailbreak耐性の内部計測・定量化

Secure

AIを守る

解釈性を活用したガードレール基盤、LLM診断、ガバナンス設計を統合し、ミッションクリティカル領域でのAI活用を支えます。

Blog

All Blog

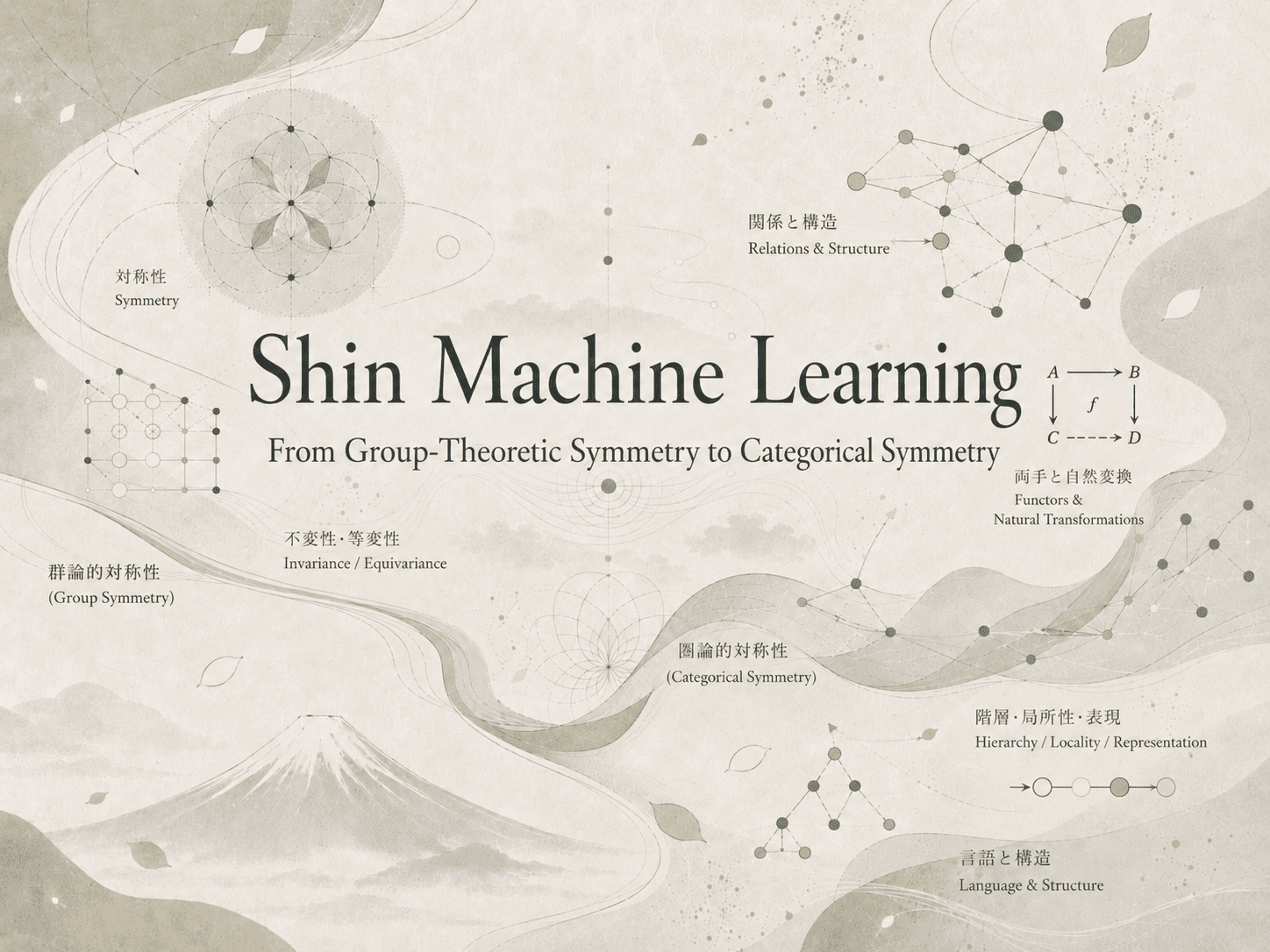

Shin Machine Learning: From Group-Theoretic Symmetry to Categorical Symmetry

Intelligence — it has been humanity's greatest weapon, privilege, and mystery. As the highest reach of dizzying technological development, an intellig...

AI Interpretability Is the Supreme Imperative

AI is developing more and more with each passing moment, and it continues to grow. In a few years, models will come to wield overwhelming power. Bef...

Reproducing the Linear Representation Hypothesis and Feature Geometry in LLMs

Centered on the Park paper and the Golechha blog, we reproduce the linear representation hypothesis and feature geometry of LLMs across 4 models (Gemma-2B, LLaMA-3-8B, Qwen3.5-2B, LLM-jp-4-8B) × 30 seeds. We add an extension to a Japanese WordNet and an original quantification of Park's 70% independent subsample diagnostic, and show that while near-zero cosine alone is insufficient evidence, Park's additional diagnostic — which captures structure that remains in the trained unembedding — still retains discriminative power.